En tant que développeur sénior et ingénieur, avec plusieurs années d'expérience dans les systèmes d'information, j'utilise aujourd'hui l'IA générative de plus en plus souvent pour coder.

Au fil des mois — et à mesure que les modèles progressent — mon usage a évolué. Là où je sollicitais initialement l'IA pour des problématiques complexes ou chronophages, je lui confie désormais aussi des tâches beaucoup plus simples. Non par paresse, mais parce que l'outil est devenu suffisamment fiable pour accélérer des actions à faible valeur ajoutée, tout en me laissant me concentrer sur l'essentiel.

Avec l'expérience, j'ai appris à dialoguer efficacement avec l'IA. Je sais précisément quoi lui demander, comment cadrer une réponse, comment imposer une structure — notamment lorsqu'il s'agit de produire du code. Je ne lui demande pas simplement « d'écrire », je lui demande comment écrire, dans quel cadre, avec quelles contraintes.

Mais cette efficacité a aussi mis en évidence une limite importante : le code généré est parfois trop verbeux, inutilement complexe ou mal optimisé. Il fonctionne, mais il n'est pas toujours élégant, maintenable ou adapté à un contexte réel de production.

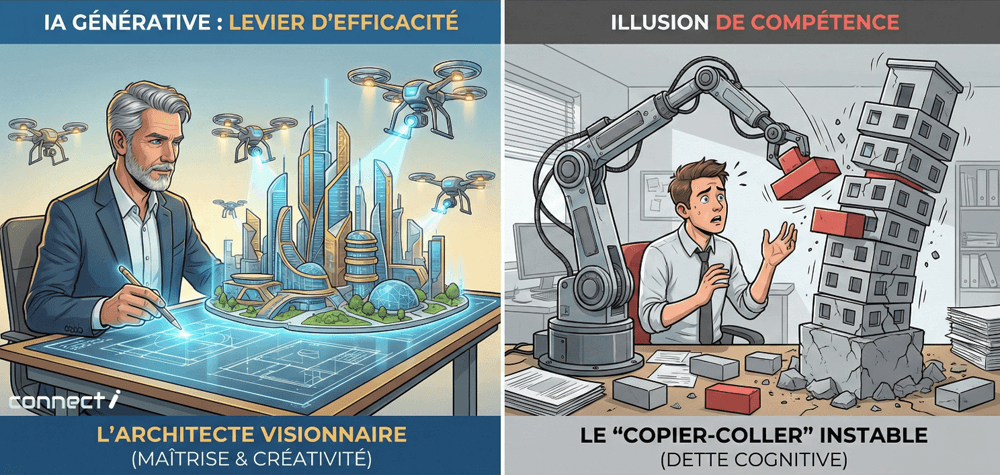

C'est précisément à ce moment-là que l'expérience humaine reprend toute sa valeur. La capacité à relire, simplifier, optimiser, anticiper les effets de bord, ou refuser une solution pourtant « fonctionnelle », repose sur une maîtrise profonde du métier — pas sur l'outil.

Cette expérience m'a confirmé une chose essentielle :

L'IA ne remplace pas l'expertise, elle la révèle.

Plus je maîtrise mon domaine, plus l'IA devient un levier puissant. À l'inverse, sans compréhension solide des fondamentaux, il devient difficile — voire risqué — de distinguer une solution pertinente d'une solution simplement plausible.